Communications

La branche de l'équipe du FLI chargée de l'éducation et de la communication.

Introduction

Informer le discours autour de nos domaines d'intervention.

L'équipe chargée de la sensibilisation s'efforce d'améliorer la prise de conscience, de fournir des informations précises et accessibles et d'approfondir la compréhension de nos domaines d'intervention. À l'aide de stratégies de communication sur les risques fondées sur des données probantes, nous cherchons à mettre l'accent sur les mesures positives permettant de réduire les risques extrêmes liés aux technologies de transformation et d'améliorer les perspectives mondiales.

À cette fin, nous créons du contenu informatif, gérons des comptes dynamiques sur les médias sociaux, collaborons avec des journalistes et décernons le prix Future of Life, qui récompense les efforts individuels héroïques méconnus qui ont fait de notre monde un endroit meilleur et plus sûr.

À cette fin, nous créons du contenu informatif, gérons des comptes dynamiques sur les médias sociaux, collaborons avec des journalistes et décernons le prix Future of Life, qui récompense les efforts individuels héroïques méconnus qui ont fait de notre monde un endroit meilleur et plus sûr.

Notre travail

Projets de sensibilisation

En savoir plus sur nos projets actuels :

La Déclaration pour une IA pro-humaine

Une coalition bipartisane remarquable, composée d'organisations de premier plan et de personnalités éminentes, a annoncé son soutien à un ensemble de principes pro-humains destinés à guider notre avenir commun avec l'IA.

Protéger ce qui est humain

Nous mettons en place un mouvement pro-humain en faveur d'une réglementation sensée visant à garantir la sécurité et le contrôle de l'IA, en commençant par une campagne publicitaire nationale diffusée aux États-Unis.

Inversion de contrôle

Pourquoi les agents d'IA superintelligents que nous nous efforçons de créer absorberaient le pouvoir, au lieu de l'octroyer ?

Déclaration sur la superintelligence

Une coalition étonnamment large s'est prononcée contre la superintelligence dangereuse : Les chercheurs en IA, les leaders religieux, les pionniers du monde des affaires, les décideurs politiques, le personnel de la sécurité nationale et les acteurs s'unissent.

Concours de création : Garder l'avenir humain

Plus de 100 000 dollars de prix pour des médias numériques créatifs qui reprennent les idées clés de l'essai, les aident à atteindre un plus grand nombre de personnes et les incitent à agir dans le monde réel.

Accélérateur de médias numériques

L'accélérateur de médias numériques soutient le contenu numérique de créateurs qui sensibilisent aux développements et aux problèmes actuels de l'IA et les font mieux comprendre.

Garder l'avenir humain

Pourquoi et comment nous devrions fermer les portes de l'AGI et de la superintelligence, et ce que nous devrions construire à la place ? Un nouvel essai d'Anthony Aguirre, directeur exécutif de FLI.

L'engagement des parties prenantes pour une IA sûre et prospère

FLI lance de nouvelles subventions pour éduquer et engager les groupes de parties prenantes, ainsi que le grand public, dans le mouvement en faveur d'une IA sûre, sécurisée et bénéfique.

Concours créatif sur la superintelligence

Le concours du meilleur matériel de formation créatif sur la superintelligence, les risques associés, ainsi que sur les répercussions de cette technologie dans notre monde. 5 prix de 10 000 $ chacun.

La lettre des sages sur les menaces existentielles

Les sages, le Future of Life Institute et de nombreuses personnalités éminentes appellent les dirigeants du monde à s'attaquer d'urgence aux dommages et aux risques croissants de la crise du climat, des pandémies, des armes nucléaires et de l'IA non gouvernée.

Lutter contre les "deepfakes

Dans le cadre d'une coalition croissante d'organisations concernées, FLI appelle les législateurs à prendre des mesures significatives pour perturber la chaîne d'approvisionnement en deepfakes pilotée par l'IA.

Sensibilisation aux armes autonomes

Les applications militaires de l'IA se développent rapidement. Nous élaborons des documents pédagogiques sur la manière dont certaines catégories restreintes d'armes utilisant l'IA peuvent nuire à la sécurité nationale et déstabiliser la civilisation, notamment les armes dans lesquelles la décision de tuer est entièrement déléguée à des algorithmes.

L'escalade artificielle

Notre film de science-fiction montre un monde, où l'intelligence artificielle (IA) est intégrée aux systèmes de commandement, de contrôle et de communication des armes nucléaires ("NC3"), avec des résultats terrifiants.

Concours de construction d'univers

Le Future of Life Institute a accepté les candidatures d'équipes venant du monde entier pour participer à un concours doté d'un prix allant jusqu'à 100 000 $. L'objectif est de concevoir des visions d'un avenir plausible et ambitieux, qui inclut fortement l'intelligence artificielle.

Future of Life Award

Chaque année, le Future of Life Award est décerné à un ou plusieurs héros méconnus qui ont contribué de manière significative à préserver l'avenir de la vie.

Future of Life Institute Podcast

Un podcast consacré à des entretiens avec certains des plus grands intellectuels et acteurs mondiaux dans le domaine des technologies émergentes et de la réduction des risques. Plus de 140 épisodes depuis 2015, 4,8/5 étoiles sur Apple Podcasts.

Tous nos travaux

Nos contenus

Vidéos à l'affiche

Voici quelques-unes des vidéos que nous avons produites nous-mêmes ou en collaboration avec d'autres créateurs de contenus :

Pourquoi est-ce si difficile de guérir le cancer ?

1 Avril, 2026

Un expert en IA explique pourquoi il a quitté OpenAI

18 Décembre, 2025

Nos contenus

Réalisations

Quelques-unes de nos réalisations

Voici quelques-unes des réalisations, dont nous sommes les plus fiers dans ce domaine :

Les Future of Life Awards récompensent 18 héros méconnus

Chaque année depuis 2017, le Future of Life Award récompense les personnes qui ont contribué à aider à préserver les conditions de vie.

Voir l'Award

Production d'une série de vidéos de sensibilisation sur les armes autonomes létales.

Nous avons produit deux courts métrages décrivant un monde, dans lequel la prolifération des armes autonomes a été autorisée.

Regardez les vidéos

Nous avons interrogé plus de 100 experts dans nos domaines de prédilection.

Au cours des cinq dernières années, notre équipe a organisé des conversations approfondies avec plus de 100 personnalités de premier plan dans des domaines liés à nos domaines d'intervention, qui sont toutes disponibles gratuitement sur notre podcast.

Écouter le podcast

Mentions dans les médias

Articles

Articles à la une

Des scientifiques de renom, des chefs religieux, des responsables politiques et des artistes appellent à l'interdiction de la superintelligence, alors qu'un sondage révèle que les Américains n'en veulent pas

Parmi les premiers signataires figurent les pionniers de l'IA Yoshua Bengio et Geoffrey Hinton, les personnalités médiatiques de premier plan Steve Bannon et Glenn Beck, la conseillère à la sécurité nationale de Barack Obama, Susan Rice, les pionniers du monde des affaires Steve Wozniak et Richard Branson, cinq lauréats du prix Nobel, l'ancienne présidente irlandaise Mary Robinson, les acteurs Stephen Fry et Joseph Gordon-Levitt, ainsi que des centaines d'autres personnalités.

27 Mars, 2026

Le gouverneur DeSantis demande aux agences de l'État de Floride de s'associer au Future of Life Institute protéger les familles contre les dangers de l'IA.

Cette collaboration permettra d'élaborer un programme de formation pour les conseillers en situation de crise et un formulaire de signalement des dangers liés à l'IA à l'échelle de l'État, ciblant les applications d'IA dangereuses.

9 Mars, 2026

« Voilà ce que signifie être pro-humain », déclare une large coalition regroupant des groupes conservateurs, progressistes et de la société civile dans une déclaration de principes communs sur l'IA

Alors que la controverse autour des excès de la Silicon Valley ne cesse de s'amplifier, un groupe remarquablement diversifié, représentant l'ensemble du spectre politique, a annoncé une série de principes relatifs à l'intelligence artificielle visant à définir clairement les objectifs de ce mouvement émergent en faveur de l'humain.

4 Mars, 2026

Déclaration de Max Tegmark concernant l'ultimatum du ministère de la Guerre

« Notre sécurité et nos droits fondamentaux ne doivent pas être à la merci de la politique interne d'une entreprise ; les législateurs doivent s'efforcer de codifier ces lignes rouges, qui bénéficient d'un soutien massif de la population, dans la loi. »

27 Février, 2026

Future of Life Institute une campagne nationale de plusieurs millions de dollars en faveur de la réglementation de l'IA

La campagne « Protect What’s Human » militera en faveur de règles de sécurité de bon sens en matière d'IA aux niveaux fédéral et des États

9 Février, 2026

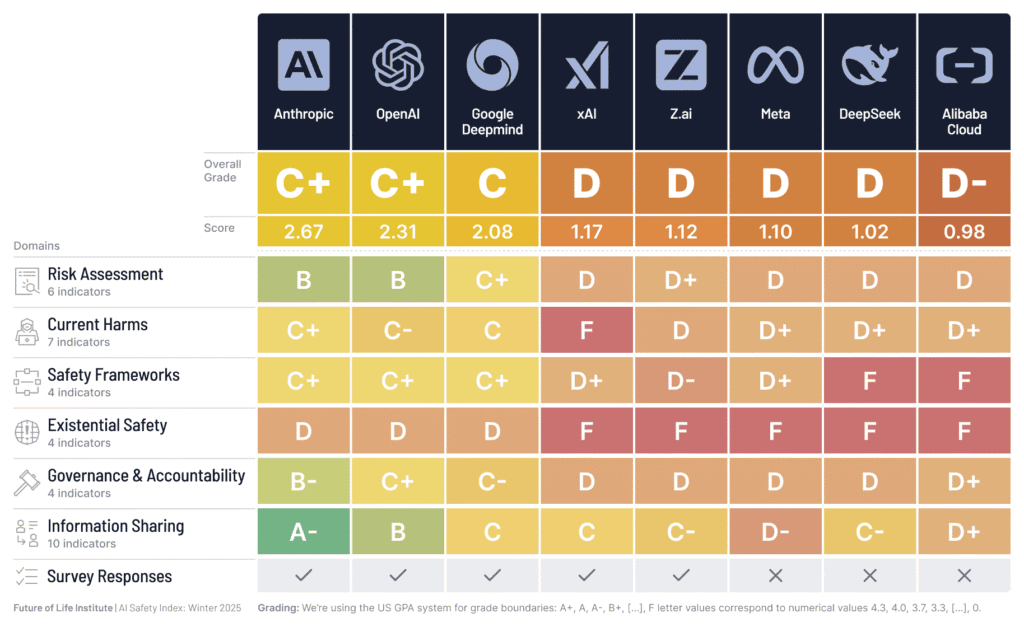

Les pratiques de sécurité des entreprises spécialisées dans l'IA ne sont pas à la hauteur de leurs engagements publics et révèlent des faiblesses structurelles, tandis que les plus performantes creusent l'écart

Mais, dans un élan en faveur de la transparence, cinq grandes entreprises ont participé pour la première fois à l'enquête menée dans le cadre de ce classement, fournissant ainsi au public de nouvelles informations essentielles.

2 Décembre, 2025

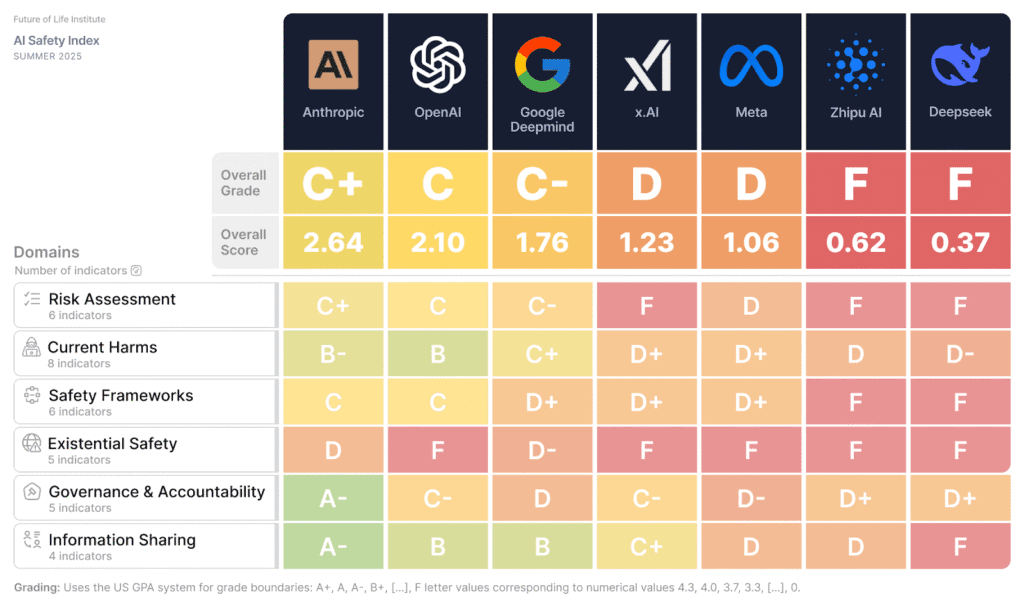

Google DeepMind se retrouve à la traîne derrière OpenAI dans la dernière évaluation de sécurité ; selon les experts, toutes les entreprises spécialisées dans l'IA sont encore loin du compte

La mise à jour estivale 2025 de l'indice de sécurité de l'IA Future of Life Institutemontre que certaines entreprises réalisent des progrès progressifs, mais que des lacunes dangereuses persistent dans des domaines clés tels que l'évaluation des risques et le contrôle des systèmes qu'elles prévoient de mettre en place.

17 Juillet, 2025

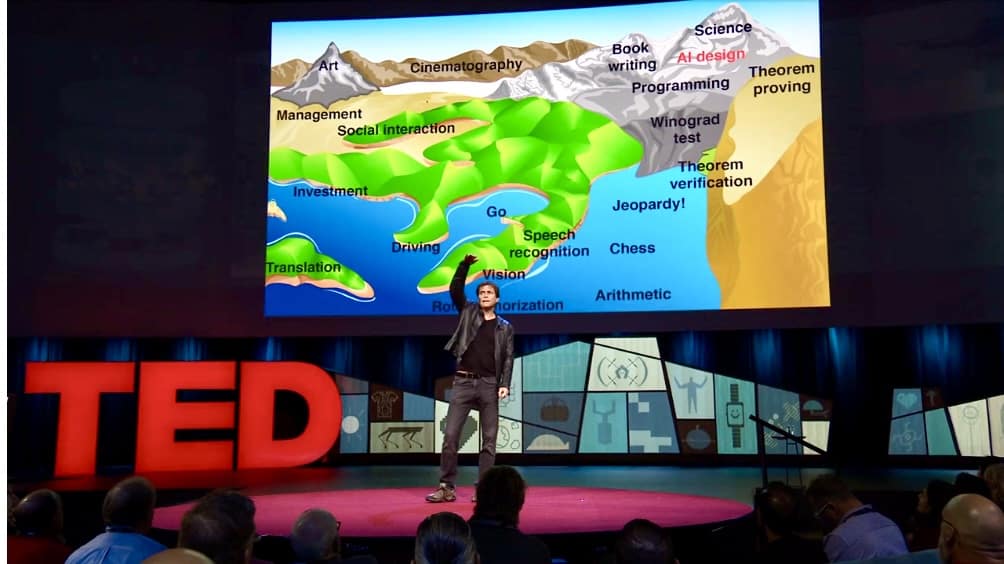

Sommes-nous proches d'une explosion du renseignement ?

Les IA se rapprochent de plus en plus d'un seuil critique. Au-delà de ce seuil, les risques sont grands, mais son franchissement n'est pas inéluctable.

21 Mars, 2025

Nos contenus

Ressources

Ressources à la une

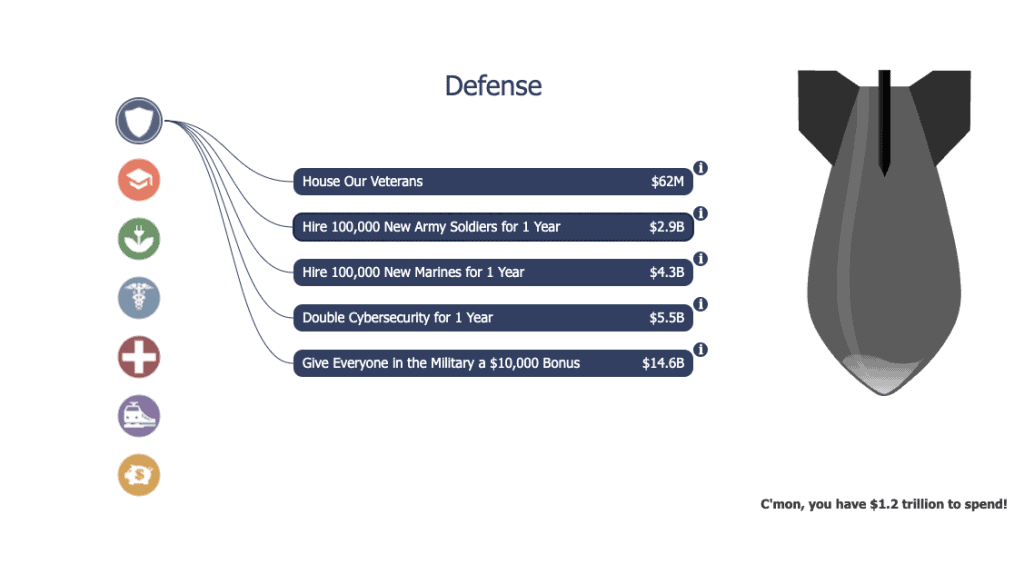

Des armes nucléaires à un milliard de dollars

Dépenseriez-vous 1,2 millard de dollars d'impôts pour des armes nucléaires ? Quelle est la valeur réelle des armes nucléaires ? La mise à niveau est-elle [...]

24 octobre, 2016

1 100 cibles nucléaires déclassifiées par les États-Unis

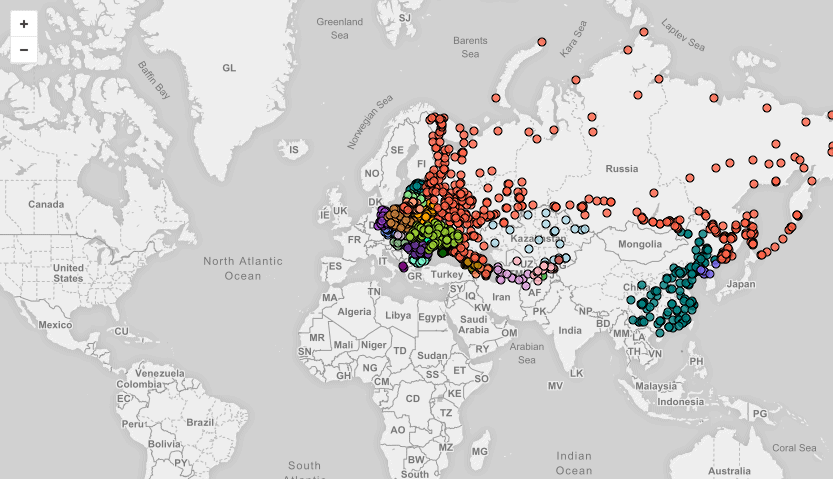

Les archives de la sécurité nationale ont récemment publié une liste déclassifiée de cibles nucléaires en 1956. Ces cibles étaient réparties sur 1 100 sites en Europe de l'Est, en Russie, en Chine et en Corée du Nord. La carte ci-dessous montre les 1 100 cibles nucléaires de cette liste. Nous nous sommes associés à NukeMap pour montrer à quel point un conflit nucléaire entre les États-Unis et la Russie pourrait être catastrophique.

12 mai, 2016

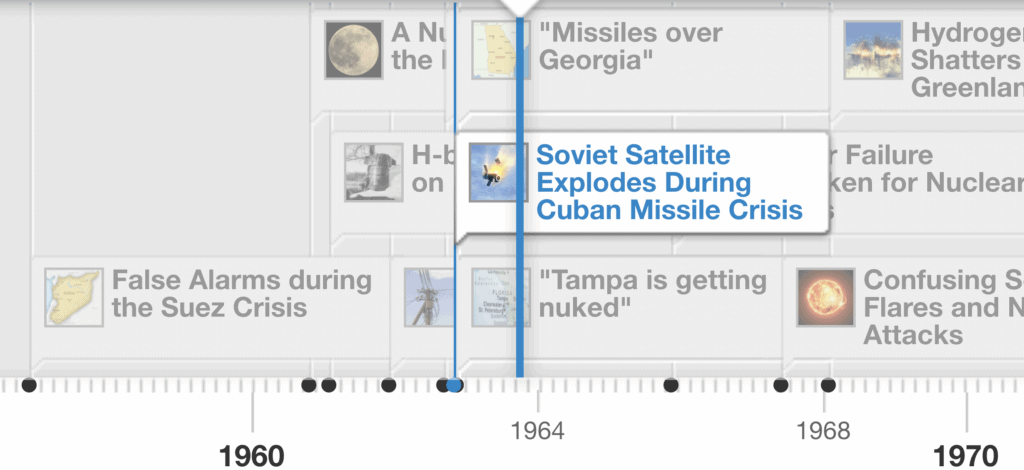

Guerre nucléaire accidentelle : une chronologie des accidents évités de justesse

La menace militaire la plus dévastatrice est sans doute celle d'une guerre nucléaire déclenchée non pas intentionnellement, mais par accident ou par erreur de calcul. Accidentel [...]

23 Février, 2016

Nos contenus

Notre équipe

Rencontrer notre équipe de sensibilisation

Nous sommes une équipe travaillant à 100 % en télétravail et répartie dans tout l'hémisphère occidental.

Ben Cumming

Chase Hardin

Gus Docker

Maggie Munro

Taylor Jones

Nous contacter

Nous vous mettrons en contact avec la bonne personne.

Nous nous efforçons de répondre à toutes les questions qui nous sont adressées dans un délai de trois jours ouvrables. Notre équipe est répartie dans le monde entier. Nous comptons donc sur votre compréhension. Tenez également compte du fait que la personne que vous contactez ne se trouve peut-être pas dans votre fuseau horaire.

Les demandes des médias et les invitations à s'exprimer pour Max Tegmark doivent être adressées à press@futureoflife.blackfin.biz. Toutes les autres demandes peuvent être envoyées à contact@futureoflife.blackfin.biz.