Intelligence artificielle

L'intelligence artificielle est en plein essor. Les entreprises créent de plus en plus de systèmes d'IA polyvalents et capables d'effectuer de nombreuses tâches différentes. Les grands modèles de langage (LLM) peuvent composer de la poésie, créer des recettes de cuisine et des codes de logiciels. Certains de ces modèles présentent déjà des risques majeurs, tels que l'érosion des processus démocratiques, la généralisation des préjugés et de la désinformation, ainsi qu'une course aux armes autonomes. Mais le pire est à venir.

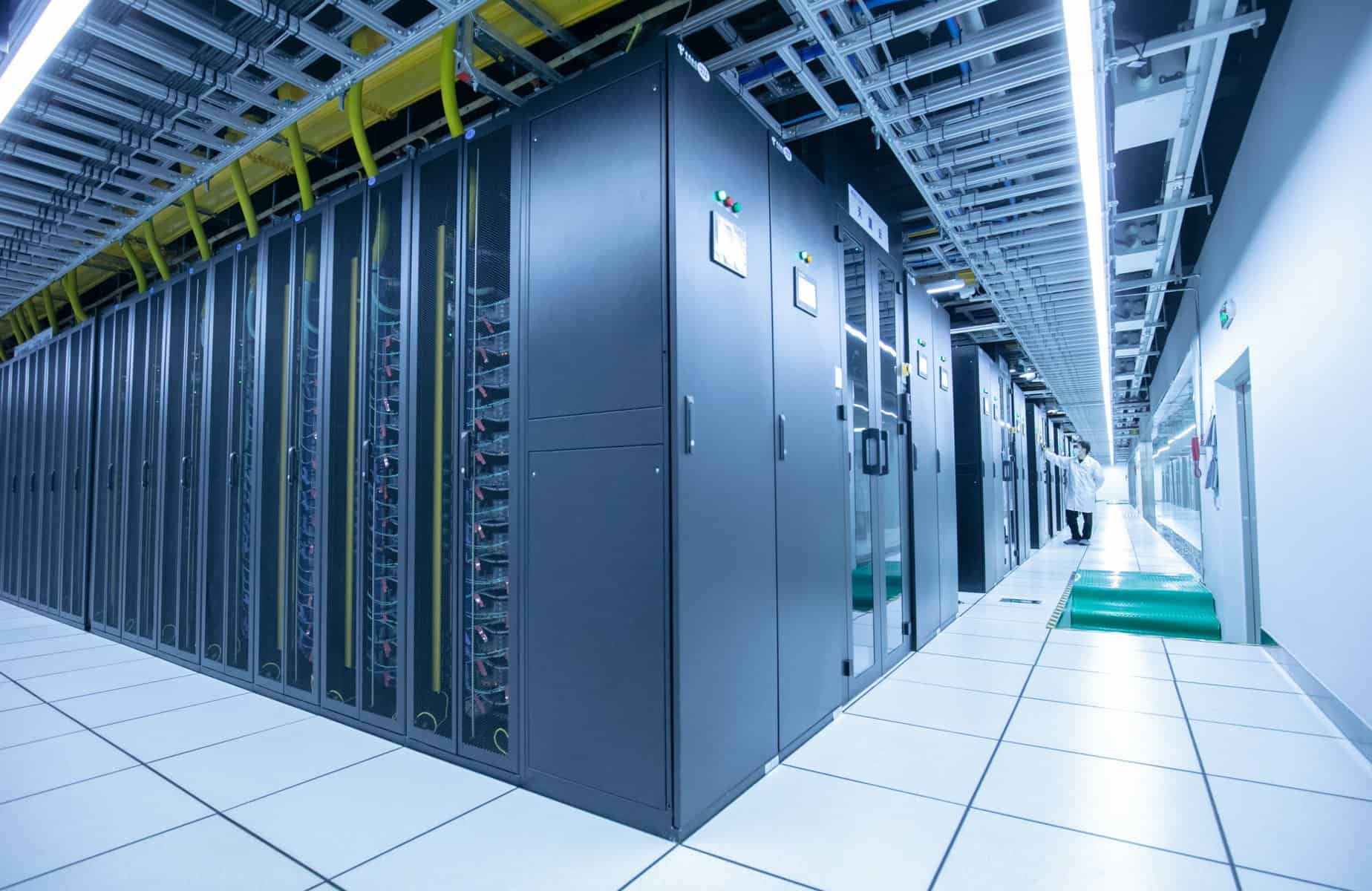

Les capacités des systèmes d'IA ne cesseront de croître. Les entreprises s'intéressent activement à l'"intelligence artificielle générale" (AGI), qui peut être aussi performante, voire meilleure, que l'être humain pour de très nombreuses tâches. Ces entreprises promettent des avantages sans précédent, allant de la guérison du cancer à l'éradication de la pauvreté dans le monde. En revanche, plus de la moitié des experts en IA estiment qu'il y a une chance sur dix que cette technologie engendre notre extinction.

Cette conviction n'a rien à voir avec les robots maléfiques ou les machines intelligentes que l'on voit dans la science-fiction. À court terme, l'IA avancée pourra permettre à ceux qui cherchent à nuire - les bioterroristes, par exemple - d'exécuter facilement des tâches de traitement complexes sans réfléchir.

À plus long terme, nous ne devrions pas nous focaliser sur une méthode de nuisance spécifique, car les risques proviennent d'une intelligence supérieure. Il suffit de penser à la façon dont l'être humain domine les animaux moins intelligents sans utiliser d'arme particulière, ou à la façon dont un programme d'échecs d'IA bat les joueurs humains sans se baser sur un coup spécifique.

Les militaires pourraient perdre le contrôle d'un système très performant conçu pour nuire, ce qui aurait pour conséquence un impact dévastateur. Un système d'IA avancé, utilisé pour maximiser les profits d'une entreprise, pourrait employer des méthodes drastiques et imprévisibles. Même une IA programmée pour faire quelque chose d'altruiste pourrait poursuivre une méthode destructrice pour atteindre cet objectif. Nous n'avons actuellement aucun moyen de savoir comment les systèmes d'IA agiront, car personne, pas même leurs créateurs, ne comprend leur fonctionnement.

La sécurité de l'IA est devenue une préoccupation majeure. Les experts et le grand public expriment la même inquiétude face aux risques émergents et à la nécessité urgente de les gérer. Mais s'inquiéter ne suffit pas. Nous avons besoin de politiques pour faire en sorte que le développement de l'IA améliore les conditions de vie partout dans le monde, et ne se contente pas d'accroître les profits des entreprises. Nous avons besoin d'une gouvernance appropriée, donc d'une réglementation rigoureuse et d'institutions capables d'orienter cette technologie de transformation en évitant les risques extrêmes et en la mettant au service de l'humanité.

Autres domaines d'intervention

Armes nucléaires

Biotechnologie

Contenu récent sur l'intelligence artificielle

Articles

Des scientifiques de renom, des chefs religieux, des responsables politiques et des artistes appellent à l'interdiction de la superintelligence, alors qu'un sondage révèle que les Américains n'en veulent pas

Déclaration : Responsable de la politique américaine concernant les recommandations législatives de la Maison Blanche en matière d'IA

Le gouverneur DeSantis demande aux agences de l'État de Floride de s'associer au Future of Life Institute protéger les familles contre les dangers de l'IA.

« Voilà ce que signifie être pro-humain », déclare une large coalition regroupant des groupes conservateurs, progressistes et de la société civile dans une déclaration de principes communs sur l'IA

Déclaration de Max Tegmark concernant l'ultimatum du ministère de la Guerre

Future of Life Institute une campagne nationale de plusieurs millions de dollars en faveur de la réglementation de l'IA

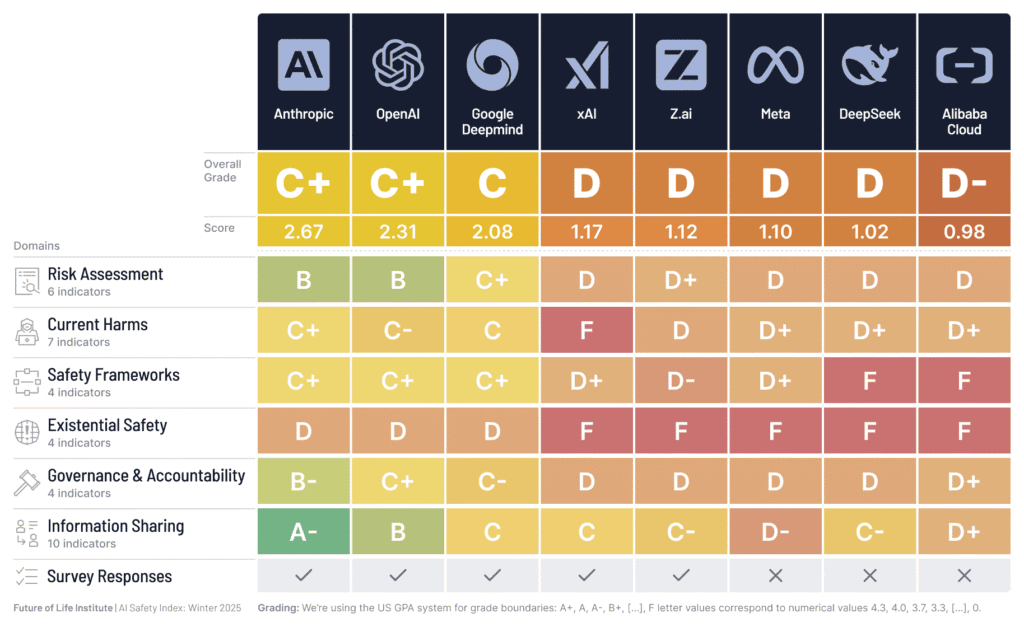

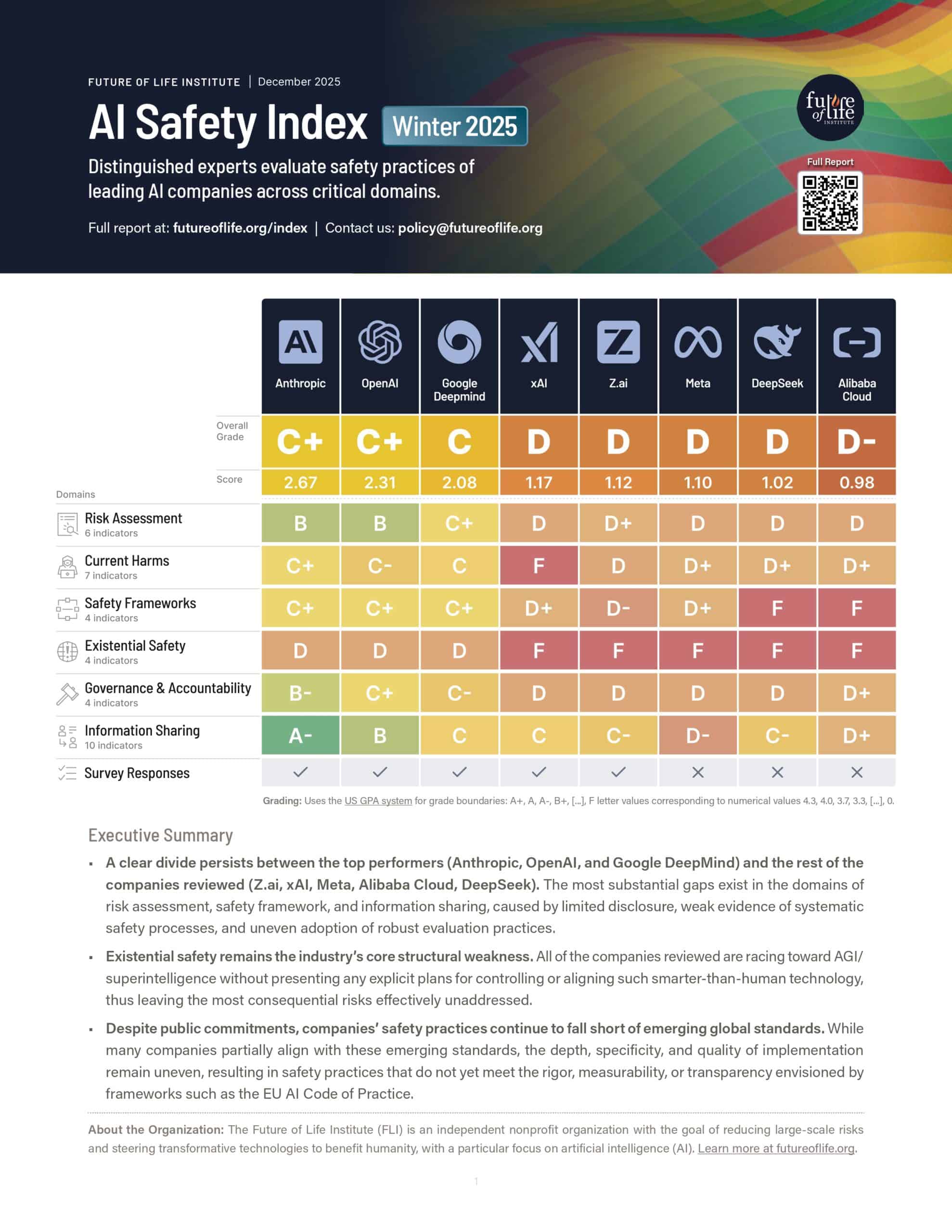

Les pratiques de sécurité des entreprises spécialisées dans l'IA ne sont pas à la hauteur de leurs engagements publics et révèlent des faiblesses structurelles, tandis que les plus performantes creusent l'écart

Michael Kleinman réagit à l'avancée de la législation sur la sécurité de l'IA

Ressources

Agences fédérales américaines : Cartographie des activités d'IA

Scénarios catastrophes de l'IA

Ressources préliminaires sur les risques liés à l'IA

Ressources sur la politique en matière d'IA

Documents de politique générale

Recommandations FLIpour le Sommet sur l'impact de l'IA

Indice de sécurité de l'IA : hiver 2025 (résumé de 2 pages)

Inversion de contrôle

Commutateurs hors tension intégrés pour le calcul IA

Vidéos

Pourquoi est-ce si difficile de guérir le cancer ?

Podcasts

Lettres ouvertes

La Déclaration pour une IA pro-humaine

Déclaration sur la superintelligence

Lettre ouverte appelant les dirigeants mondiaux à adopter un leadership à long terme face aux menaces existentielles

L'octroi de licences d'IA pour un avenir meilleur : S'attaquer aux préjudices actuels et aux menaces émergentes

Future of Life Awards