Kommunikation

Die Bildungs- und Kommunikationsabteilung des FLI Teams.

Einführung

Informieren des Diskurses über unsere Schwerpunktbereiche.

Das Outreach-Team arbeitet daran, das Bewusstsein zu schärfen, genaue und zugängliche Informationen bereitzustellen und das Verständnis für unsere Schwerpunktbereiche zu vertiefen. Mit evidenzbasierten Strategien der Risikokommunikation versuchen wir, positive Schritte hervorzuheben, mit denen extreme Risiken durch transformative Technologien verringert und die globalen Aussichten verbessert werden können.

Zu diesem Zweck erstellen wir informative Inhalte, betreiben dynamische Konten in den sozialen Medien, arbeiten mit Journalisten zusammen und veranstalten den Future of Life Award, mit dem wir unbesungene, heldenhafte Einzelleistungen würdigen, die unsere Welt zu einem besseren, sichereren Ort gemacht haben.

Zu diesem Zweck erstellen wir informative Inhalte, betreiben dynamische Konten in den sozialen Medien, arbeiten mit Journalisten zusammen und veranstalten den Future of Life Award, mit dem wir unbesungene, heldenhafte Einzelleistungen würdigen, die unsere Welt zu einem besseren, sichereren Ort gemacht haben.

Unsere Arbeit

Outreach Projekte

Erfahren Sie mehr über unsere laufenden Projekte:

Die Pro-Human-KI-Erklärung

Eine bemerkenswerte überparteiliche Koalition führender Organisationen und prominenter Persönlichkeiten hat ihre Unterstützung für eine Reihe von Pro-Human-Prinzipien angekündigt, die als Leitlinien für unsere gemeinsame Zukunft mit KI dienen sollen.

Schütze das Menschliche

Wir bauen eine menschenfreundliche Bewegung für eine vernünftige Regulierung auf, um KI sicher und unter unserer Kontrolle zu halten. Den Auftakt bildet eine nationale Werbekampagne, die in den USA ausgestrahlt wird.

Kontrolle Umkehrung

Warum die superintelligenten KI-Agenten, die wir erschaffen wollen, Macht absorbieren, statt sie zu gewähren | Die neueste Studie von Anthony Aguirre.

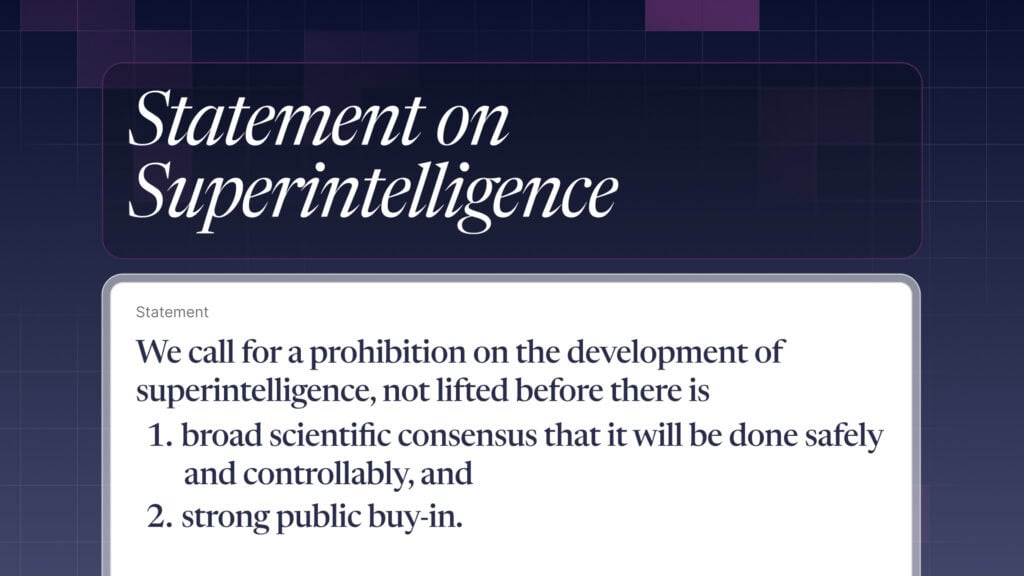

Erklärung zur Superintelligenz

Eine erstaunlich breite Koalition hat sich gegen unsichere Superintelligenz ausgesprochen: KI-Forscher, Glaubensführer, Wirtschaftspioniere, politische Entscheidungsträger, Mitarbeiter der nationalen Sicherheit und Schauspieler stehen zusammen.

Kreativ-Wettbewerb: Keep The Future Human

Preise im Wert von mehr als 100.000 $ für kreative digitale Medien, die sich mit den Kerngedanken des Aufsatzes auseinandersetzen, ihnen helfen, ein breiteres Publikum zu erreichen und zum Handeln in der realen Welt motivieren.

Digital Media Accelerator

Der Digital Media Accelerator unterstützt digitale Inhalte von Urhebern, die das Bewusstsein und das Verständnis für aktuelle KI-Entwicklungen und -Themen fördern.

Die Zukunft menschlich gestalten

Warum und wie wir die Tore zu AGI und Superintelligenz schließen sollten, und was wir stattdessen bauen sollten | Ein neuer Essay von Anthony Aguirre, Geschäftsführer des FLI.

Engagement mehrerer Interessengruppen für eine sichere und prosperierende KI

Das FLI lanciert neue Stipendien, um Interessengruppen und die breite Öffentlichkeit für eine sichere und nützliche KI zu sensibilisieren und zu gewinnen.

Wettbewerb zu Visonen der Superintelligenz

Ein Wettbewerb für die besten Bildungsmaterialien zum Thema

Superintelligenz, die damit verbundenen Risiken und die Auswirkungen

dieser Technologie auf unsere Welt. Fünf Preise zu je 10.000 $.

Der Brief der Ältesten zu existenziellen Bedrohungen

Die Ältesten, das Future of Life Institute und eine Reihe herausragender Persönlichkeiten des öffentlichen Lebens fordern die Staats- und Regierungschefs der Welt auf, sich dringend mit den anhaltenden Schäden und eskalierenden Risiken durch die Klimakrise, Pandemien, Atomwaffen und unkontrollierte künstliche Intelligenz auseinanderzusetzen.

Kampf gegen Deepfakes

Als Teil einer wachsenden Koalition besorgter Organisationen fordert das FLI die Gesetzgeber auf, sinnvolle Schritte zu unternehmen, um die KI-gesteuerte Deepfake-Lieferkette zu unterbrechen.

Aufklärungsarbeit über autonome Waffensysteme

Militärische KI-Anwendungen breiten sich rasch aus. Wir entwickeln Bildungsmaterial darüber, wie bestimmte Klassen von KI-gesteuerten Waffen der nationalen Sicherheit schaden und die Zivilisation destabilisieren können, wie etwa Waffen, bei denen Tötungsentscheidungen vollständig an Algorithmen delegiert werden.

Künstliche Eskalation

Unser fiktiver Film zeigt eine Welt, in der künstliche Intelligenz in nukleare Kommando-, Kontroll- und Kommunikationssysteme (NC3) integriert wird – mit beängstigenden Folgen.

Worldbuilding-Wettbewerb

Das Future of Life Institute akzeptierte Bewerbungen von Teams aus aller Welt für ein Preisgeld von bis zu 100.000 $. Sie sollten Visionen einer plausiblen, erstrebenswerten Zukunft entwerfen, die starke künstliche Intelligenz beinhaltet.

Der Future of Life Award

Jedes Jahr wird dieser Preis an einen oder mehrere unbesungene Helden verliehen, die einen bedeutenden Beitrag zur Erhaltung der Zukunft des Lebens geleistet haben.

Future of Life Institute Podcast

Ein Interview-Podcast, der Gespräche mit einigen der weltweit führenden Denkern und Machern auf dem Gebiet der neuen Technologien und der Risikominderung bietet. Über 140 Episoden seit 2015, 4,8/5 Sterne auf Apple Podcasts.

Unsere gesamte Arbeit

Unsere Inhalte

Ausgewählte Videos

Hier finden Sie einige der Videos, die wir selbst oder in Zusammenarbeit mit anderen Content Creators produziert haben:

Warum es SO schwer ist, Krebs zu heilen

1 April, 2026

Wie man KI zum Wohle der Menschheit einsetzt

13 März, 2026

KI-Experte erklärt, warum er OpenAI verlassen hat

18 Dezember, 2025

Die Geschichte der KI erklärt: Crashkurs „Zukunft der KI“ #1

19 November, 2025

Unsere Inhalte

Errungenschaften

Einige der von uns erzielten Erfolge

Hier sind einige unserer Erfolge in diesem Bereich:

18 unbesungene Helden mit dem Future of Life Award geehrt

Mit dem Future of Life Award werden seit 2017 jedes Jahr die Beiträge von Menschen gewürdigt, die dazu beigetragen haben, die Perspektiven des Lebens zu erhalten.

Mehr zur Auszeichnung

Produktion einer viralen Videoserie, die vor tödlichen autonomen Waffen warnt

Wir haben zwei Kurzfilme produziert, die zusammen mehr als 75 Millionen Mal angesehen wurden und eine Welt zeigen, in der der Verbreitung tödlicher autonomer Waffen kein Einhalt geboten wurde.

Sehen Sie sich die Videos an

Befragung von mehr als 100 wichtigen Experten in unseren Schwerpunktbereichen

In den letzten 5 Jahren hat unser Team ausführliche Gespräche mit mehr als 100 führenden Persönlichkeiten aus den Bereichen unserer Schwerpunktthemen geführt, die alle kostenlos in unserem Podcast verfügbar sind.

Hören Sie sich den Podcast an

Erwähnungen in den Medien

Beiträge

Ausgewählte Beiträge

Prominente Wissenschaftler, Glaubensführer, Politiker und Künstler fordern ein Verbot von Superintelligenz, da Umfragen zeigen, dass die Amerikaner diese nicht wollen

Zu den Erstunterzeichnern zählen die KI-Pioniere Yoshua Bengio und Geoffrey Hinton, die bekannten Medienpersönlichkeiten Steve Bannon und Glenn Beck, Obamas nationale Sicherheitsberaterin Susan Rice, die Wirtschaftsvorreiter Steve Wozniak und Richard Branson, fünf Nobelpreisträger, die ehemalige irische Präsidentin Mary Robinson, die Schauspieler Stephen Fry und Joseph Gordon-Levitt sowie Hunderte weitere.

27 März, 2026

Gouverneur DeSantis weist Behörden des Bundesstaates Florida an, mit Future of Life Institute zusammenzuarbeiten Future of Life Institute Familien vor den Gefahren der KI zu schützen

Im Rahmen der Zusammenarbeit werden ein Schulungsprogramm für Krisenberater und ein landesweites Formular zur Meldung von Schäden durch KI entwickelt, das auf gefährliche KI-Begleit-Apps abzielt.

9 März, 2026

„Das bedeutet es, sich für den Menschen einzusetzen“, erklärt eine breite Koalition aus konservativen, progressiven und zivilgesellschaftlichen Gruppen in einer gemeinsamen Grundsatzerklärung zur KI

Angesichts der zunehmenden Kritik an den Übergriffen des Silicon Valley hat eine bemerkenswert vielfältige Gruppe aus dem gesamten politischen Spektrum eine Reihe von KI-Grundsätzen verkündet, um die Ziele der aufkommenden menschenorientierten Bewegung klar zu definieren.

4 März, 2026

Erklärung von Max Tegmark zum Ultimatum des Kriegsministeriums

„Unsere Sicherheit und unsere Grundrechte dürfen nicht der internen Politik eines Unternehmens ausgeliefert sein; der Gesetzgeber muss daran arbeiten, diese von der überwältigenden Mehrheit der Bevölkerung akzeptierten roten Linien gesetzlich zu verankern.“

27 Februar, 2026

Future of Life Institute eine millionenschwere landesweite Kampagne zur Regulierung künstlicher Intelligenz

Die Kampagne „Protect What’s Human“ wird sich auf Bundes- und Landesebene für vernünftige Sicherheitsvorschriften für KI einsetzen

9 Februar, 2026

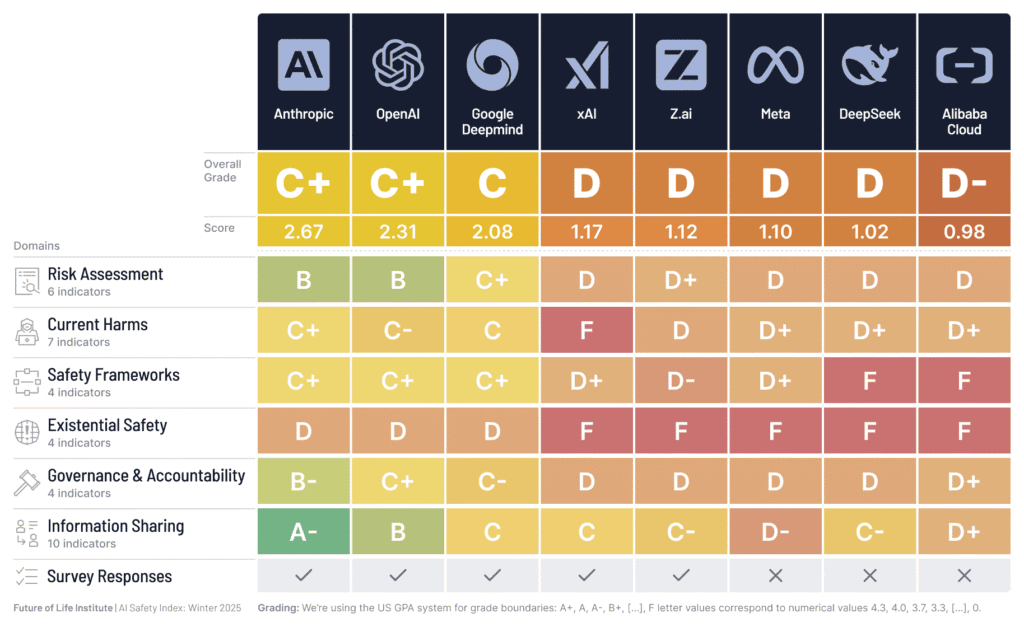

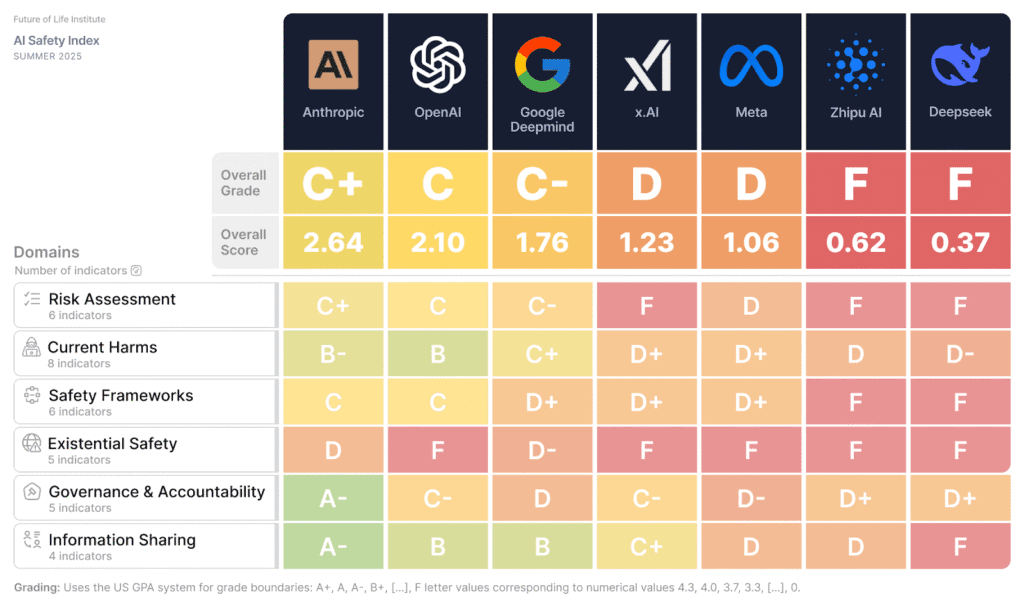

Die Sicherheitspraktiken von KI-Unternehmen bleiben hinter den öffentlichen Zusagen zurück und weisen strukturelle Schwächen auf, während die Spitzenreiter ihren Vorsprung weiter ausbauen

Ein Gewinn für die Transparenz war jedoch, dass sich fünf führende Unternehmen erstmals an der Umfrage der Scorecard beteiligten und der Öffentlichkeit damit wichtige neue Informationen zur Verfügung stellten.

2 Dezember, 2025

Google DeepMind fällt bei der jüngsten Sicherheitsüberprüfung hinter OpenAI zurück; laut Experten bleiben alle KI-Unternehmen weiterhin hinter den Erwartungen zurück

Das Sommer-Update 2025 des „AI Safety Index“ Future of Life Institutezeigt, dass einige Unternehmen zwar schrittweise Fortschritte erzielen, in Schlüsselbereichen wie der Risikobewertung und der Kontrolle der Systeme, die sie entwickeln wollen, jedoch weiterhin gefährliche Lücken bestehen.

17 Juli, 2025

Stehen wir kurz vor einer Intelligenzexplosion?

Die KI nähert sich immer mehr einer kritischen Schwelle. Jenseits dieser Schwelle lauern große Risiken - aber sie zu überschreiten ist nicht unvermeidlich.

21 März, 2025

Unsere Inhalte

Ressourcen

Ausgewählte Ressourcen

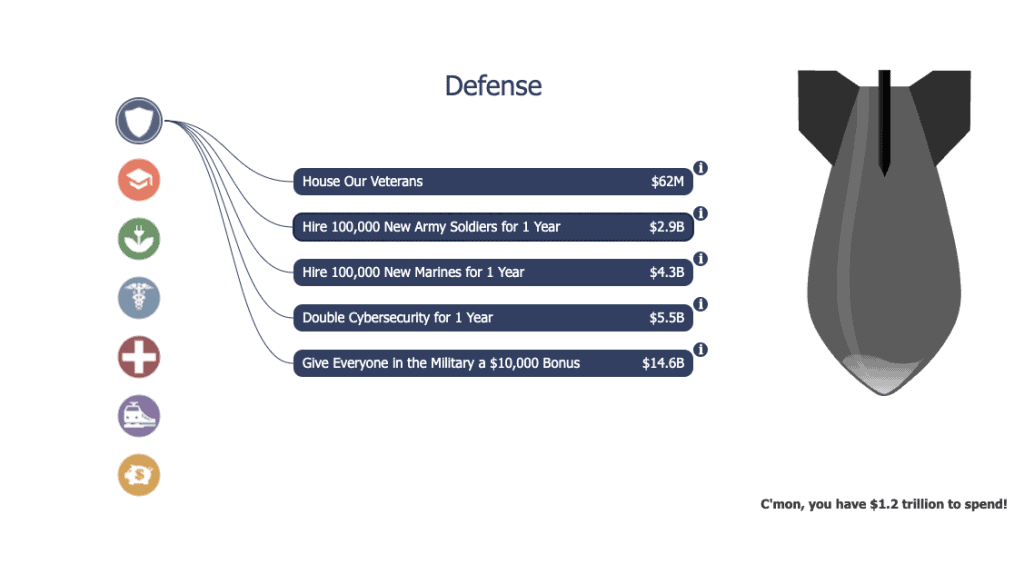

Billionen Dollar für Atombomben

Würden Sie 1,2 Billionen Dollar Steuergelder für Atomwaffen ausgeben? Wie viel sind Atomwaffen wirklich wert? Ist die Aufrüstung der [...]

24 Oktober, 2016

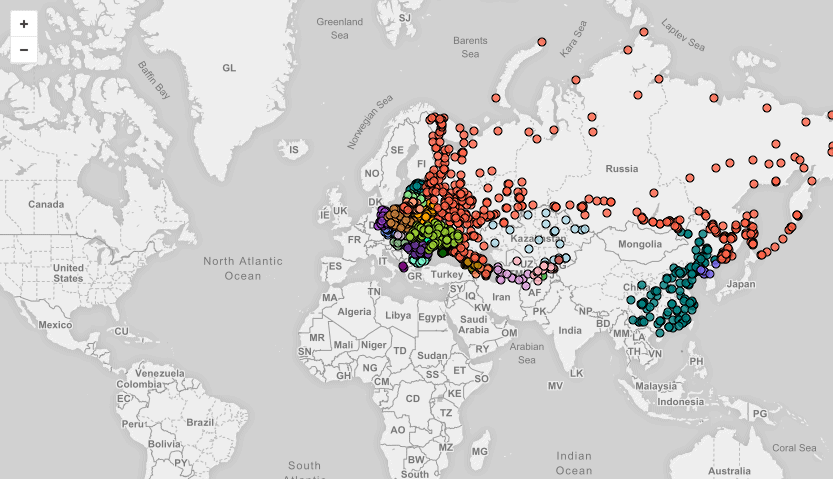

1100 deklassierte U.S.-Atomziele

Die National Security Archives haben vor kurzem eine nun freigegebene Liste von US-Atomzielen aus dem Jahr 1956 veröffentlicht, die 1.100 Standorte in Osteuropa, Russland, China und Nordkorea umfasste. Die Karte unten zeigt alle 1.100 nuklearen Ziele aus dieser Liste. Wir haben uns mit NukeMap zusammengetan, um zu zeigen, wie katastrophal ein nuklearer Schlagabtausch zwischen den Vereinigten Staaten und Russland sein könnte.

12 Mai, 2016

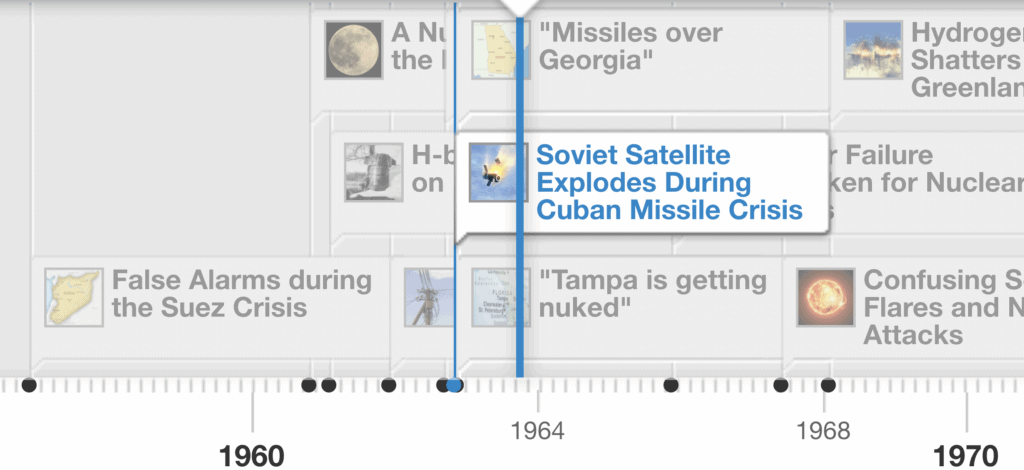

Unbeabsichtigter Nuklearkrieg: eine Zeittafel der Beinaheunfälle

Die verheerendste militärische Bedrohung könnte von einem Atomkrieg ausgehen, der nicht absichtlich, sondern durch einen Unfall oder eine Fehlkalkulation ausgelöst wird. Unbeabsichtigt [...]

23 Februar, 2016

Unsere Inhalte

Unser Team

Wir stellen vor: unser Outreach-Team

Wir sind ein Remote-Team, das über die gesamte westliche Hemisphäre verteilt ist.

Ben Cumming

Chase Hardin

Gus Docker

Maggie Munro

Taylor Jones

Kontaktieren Sie uns

Wir bringen Sie mit der richtigen Person in Kontakt.

Wir tun unser Bestes, um alle eingehenden Anfragen innerhalb von drei Werktagen zu beantworten. Unser Team ist über den ganzen Globus verteilt. Bitte nehmen Sie Rücksicht und denken Sie daran, dass die Person, die Sie kontaktieren, sich möglicherweise nicht in Ihrer Zeitzone befindet.

Bitte richten Sie Medienanfragen und Einladungen zu Vorträgen für Max Tegmark an press@futureoflife.blackfin.biz. Alle anderen Anfragen können an contact@futureoflife.blackfin.biz gesendet werden.