Unsere Arbeit

Hier finden Sie einen Überblick über unsere Arbeit, sowie über alle aktuellen und vergangenen Projekte.

Arbeitsbereiche

Unsere Arbeitsbereiche

Wir arbeiten an Projekten in mehreren verschiedenen Domänen:

Politik und Forschung

Wir engagieren uns in den Vereinigten Staaten, der Europäischen Union und auf der ganzen Welt in der Politikberatung und Forschung.

Unsere Politik und Forschungsarbeit

Zukunftsvisionen

Wir arbeiten an Projekten, die darauf abzielen, der Menschheit bei der Realisierung der Möglichkeiten zu helfen, die durch transformative Technologien entstehen.

Unsere Arbeit für die Zukunft

Outreach

Wir produzieren Bildungsmaterialien, die den öffentlichen Diskurs informieren und Menschen ermutigen sollen, sich zu engagieren.

Unsere Outreach-Arbeit

Vergabe von Förderung

Wir vergeben Fördergelder an Einzelpersonen und Organisationen, die an Projekten arbeiten, die unserem Mission vorantreiben.

Unsere Förderprogramme

Veranstaltungen

Wir versammeln führende Vertreter der einschlägigen Bereiche, um zu erörtern, wie die sichere Entwicklung und Nutzung leistungsstarker Technologien gewährleistet werden kann.

Unsere Veranstaltungen

Unsere Errungenschaften

Unsere wichtigsten Erfolge

Hier sind einige unserer Erfolge, auf die wir besonders stolz sind:

Veranstaltung der ersten KI-Sicherheitskonferenzen

Wir waren die ersten, die führende Persönlichkeiten auf dem Gebiet der KI zusammengebracht haben, um unsere Bedenken über mögliche Sicherheitsrisiken dieser neuen Technologie zu diskutieren.

Unsere Veranstaltungen ansehen

Bereitstellung des ersten Förderprogrammes für KI-Sicherheit

Von 2015-2017 führten wir das erste Förderprogramm zur Finanzierung von KI-Sicherheitsprojekten durch. Derzeit bieten wir eine Reihe von Förderungen für Projekte an, die unsere Mission vorantreiben.

Unsere Förderprogramme ansehen

Entwicklung der AI Asilomar Principles

Im Jahr 2017 koordinierte FLI die Entwicklung der Asilomar AI Principles, eine der frühesten und einflussreichsten Sammlungen von KI-Governance-Grundsätzen.

Ansicht der Grundsätze

18 unbesungene Helden mit dem Future of Life Award geehrt

Mit dem Future of Life Award werden seit 2017 jedes Jahr die Beiträge von Menschen gewürdigt, die dabei geholfen haben, die Perspektiven des Lebens auf dem Planeten zu bewahren.

Mehr zur Auszeichnung

Produktion einer viralen Videoserie, die vor tödlichen autonomen Waffen warnt

Wir haben zwei Kurzfilme produziert, die zusammen mehr als 75 Millionen Mal angesehen wurden und eine Welt zeigen, in der der Verbreitung tödlicher autonomer Waffen kein Einhalt geboten wurde.

Sehen Sie sich die Videos an

KI-Empfehlung im Plan der UN für digitale Zusammenarbeit

Unsere Empfehlungen zur globalen Governance von KI-Technologien wurden in die Pläne zur digitalen Zusammenarbeit des UN-Generalsekretärs aufgenommen.

Die Pläne ansehen

Projekte

Woran wir arbeiten

Hier finden Sie eine Übersicht aller Projekte, an denen wir derzeit arbeiten:

Religiöse Perspektiven auf eine positive KI-Zukunft

Der Großteil der Weltbevölkerung gehört einer Religion an. Dennoch sind die Perspektiven dieser Religionen in den strategischen Diskussionen über künstliche Intelligenz weitgehend abwesend. Diese Initiative zielt darauf ab, religiöse Gruppen dabei zu unterstützen, ihre glaubensspezifischen Bedenken und Hoffnungen für eine Welt mit KI zu äußern und mit ihnen zusammenzuarbeiten, um Schäden abzuwenden und Vorteile zu realisieren.

Empfehlungen für den AI-Aktionsplan der USA

Der Vorschlag des Future of Life Institute für den KI-Aktionsplan von Präsident Trump. Unsere Empfehlungen zielen darauf ab, die Präsidentschaft vor dem Kontrollverlust über KI zu schützen, die Entwicklung von KI-Systemen frei von ideologischen oder sozialen Agenden zu fördern, amerikanische Arbeitnehmer vor Arbeitsplatzverlust und Ersatz zu schützen und vieles mehr.

Engagement mehrerer Interessengruppen für eine sichere und prosperierende KI

Das FLI lanciert neue Stipendien, um Interessengruppen und die breite Öffentlichkeit für eine sichere und nützliche KI zu sensibilisieren und zu gewinnen.

Digital Media Accelerator

Der Digital Media Accelerator unterstützt digitale Inhalte von Urhebern, die das Bewusstsein und das Verständnis für aktuelle KI-Entwicklungen und -Themen fördern.

Die Zukunft menschlich gestalten

Warum und wie wir die Tore zu AGI und Superintelligenz schließen sollten, und was wir stattdessen bauen sollten | Ein neuer Essay von Anthony Aguirre, Geschäftsführer des FLI.

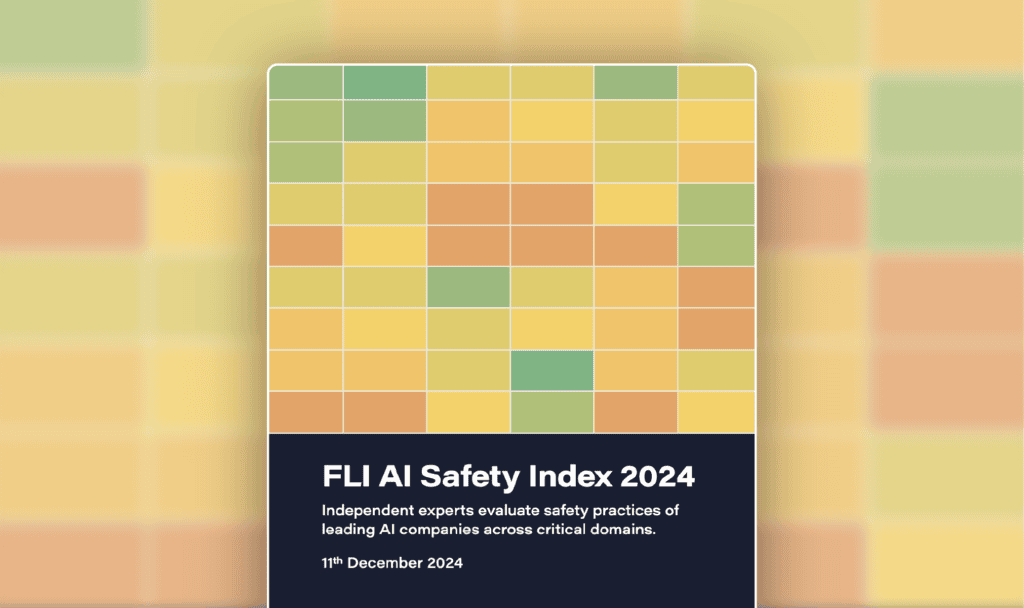

FLI AI-Sicherheitsindex 2024

Sieben KI- und Governance-Experten bewerten die Sicherheitspraktiken von sechs führenden KI-Unternehmen für allgemeine Zwecke.

KI-Konvergenz: Risiken am Schnittpunkt von KI zu nuklearen, biologischen und Cyber-Bedrohungen

Das Gefahrenpotenzial von KI-Systemen kann die Gefahrenpotenziale anderer Technologien verstärken – dies wird als KI-Konvergenz bezeichnet. Wir bieten politischen Entscheidungsträgern in den Vereinigten Staaten politische Expertise in drei wichtigen Konvergenzbereichen: Bio-, Nuklear- und Cybertechnologien.

Wettbewerb zu Visonen der Superintelligenz

Ein Wettbewerb für die besten Bildungsmaterialien zum Thema

Superintelligenz, die damit verbundenen Risiken und die Auswirkungen

dieser Technologie auf unsere Welt. Fünf Preise zu je 10.000 $.

KI-Sicherheitsgipfel

Die Regierungen erkunden die Zusammenarbeit bei der Navigation in einer Welt mit fortschrittlicher KI. FLI steht ihnen mit Rat und Tat zur Seite.

Auseinandersetzung mit AI Executive Orders

Wir bieten formellen Input für Behörden in der gesamten US-Regierung, einschließlich technischem und politischem Fachwissen zu einem breiten Spektrum von Themen wie Exportkontrollen, Hardware-Governance, Standardisierung, Beschaffungswesen und mehr.

Der Brief der Ältesten zu existenziellen Bedrohungen

Die Ältesten, das Future of Life Institute und eine Reihe herausragender Persönlichkeiten des öffentlichen Lebens fordern die Staats- und Regierungschefs der Welt auf, sich dringend mit den anhaltenden Schäden und eskalierenden Risiken durch die Klimakrise, Pandemien, Atomwaffen und unkontrollierte künstliche Intelligenz auseinanderzusetzen.

Umsetzung des europäischen AI-Gesetzes

Zu unseren wichtigsten Empfehlungen gehören die Ausweitung des Geltungsbereichs des Gesetzes zur Regulierung von allgemeinen KI-Systemen, sowie die Ausweitung der Definition verbotener Manipulation auf alle Arten von Manipulationstechniken sowie auf Manipulationen, die gesellschaftlichen Schaden verursachen.

Kampf gegen Deepfakes

Als Teil einer wachsenden Koalition besorgter Organisationen fordert das FLI die Gesetzgeber auf, sinnvolle Schritte zu unternehmen, um die KI-gesteuerte Deepfake-Lieferkette zu unterbrechen.

Aufklärungsarbeit über autonome Waffensysteme

Militärische KI-Anwendungen breiten sich rasch aus. Wir entwickeln Bildungsmaterial darüber, wie bestimmte Klassen von KI-gesteuerten Waffen der nationalen Sicherheit schaden und die Zivilisation destabilisieren können, wie etwa Waffen, bei denen Tötungsentscheidungen vollständig an Algorithmen delegiert werden.

Globale KI-Governance bei den UN

Unsere Beteiligung an der Arbeit der Vereinten Nationen erstreckt sich über mehrere Jahre und Initiativen, darunter die Roadmap for Digital Cooperation und der Global Digital Compact (GDC).

Realisierung erstrebenswerter Zukunftsvisionen - Neue FLI-Fördermöglichkeiten

Wir stellen zwei neue Fördermöglichkeiten bereit, um Forschung zur sicheren Nutzung von KI zu unterstützen und so die Welt zu einem besseren Ort zu machen.

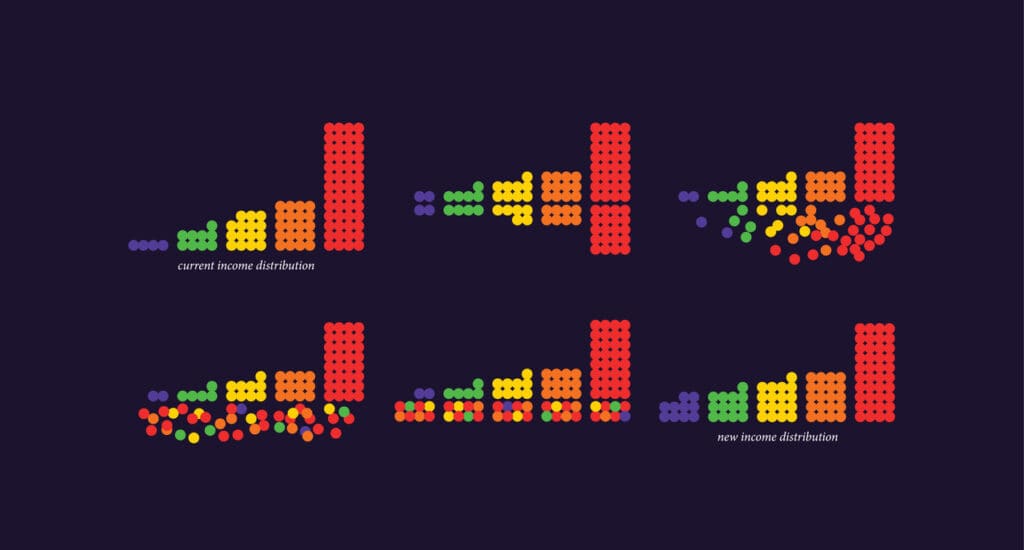

Der Windfall Trust

Der Windfall Trust hat sich zum Ziel gesetzt, die wirtschaftlichen Auswirkungen der durch KI verursachten Arbeitslosigkeit durch den Aufbau eines globalen, allgemein zugänglichen sozialen Sicherheitsnetzes zu mildern.

Imagine A World Podcast

Können Sie sich eine Welt im Jahr 2045 vorstellen, in der es uns gelingt, die Klimakrise, große Kriege und die potenziellen Gefahren künstlicher Intelligenz zu vermeiden? Unsere neue Podcast-Reihe erforscht, wie wir eine positivere Zukunft gestalten könnten, und bietet Denkanstöße für konkrete Schritte.

Künstliche Eskalation

Unser fiktiver Film zeigt eine Welt, in der künstliche Intelligenz in nukleare Kommando-, Kontroll- und Kommunikationssysteme (NC3) integriert wird – mit beängstigenden Folgen.

Worldbuilding-Wettbewerb

Das Future of Life Institute akzeptierte Bewerbungen von Teams aus aller Welt für ein Preisgeld von bis zu 100.000 $. Sie sollten Visionen einer plausiblen, erstrebenswerten Zukunft entwerfen, die starke künstliche Intelligenz beinhaltet.

Der Future of Life Award

Jedes Jahr wird dieser Preis an einen oder mehrere unbesungene Helden verliehen, die einen bedeutenden Beitrag zur Erhaltung der Zukunft des Lebens geleistet haben.

Future of Life Institute Podcast

Ein Interview-Podcast, der Gespräche mit einigen der weltweit führenden Denkern und Machern auf dem Gebiet der neuen Technologien und der Risikominderung bietet. Über 140 Episoden seit 2015, 4,8/5 Sterne auf Apple Podcasts.

Verwandte Seiten

Haben Sie nach etwas anderem gesucht?

Hier sind ein paar andere Seiten, die Sie vielleicht finden wollten:

Unsere Mission

Lesen Sie mehr über unsere Mission und unsere Grundprinzipien.

Hilf mit

Unabhängig von Ihrer Erfahrung oder Ihrem Alter – Sie können etwas tun, um uns zu helfen, die Zukunft des Lebens positiv zu gestalten.

Veranstaltungen

Wir versammeln führende Vertreter der einschlägigen Bereiche, um zu erörtern, wie die sichere Entwicklung und Nutzung leistungsstarker Technologien gewährleistet werden kann.